フォレンジックの成否は「時刻」で決まる:NTP時刻同期と改ざん防止ログ保存設計、SIEM活用まで徹底解説

1分でわかるこの記事の要約 サイバー攻撃調査において、ログの時刻同期がずれているとタイムライン分析が崩壊し、原因究明が困...

更新日:2025年12月11日

1分でわかるこの記事の要約 AIシステムの運用には、性能や挙動を継続的に見守るAI監視が不可欠です。 AI監視はMLOps、AIセキュリティ、業務監査の3つの主要領域で重要な役割を果たします。 MLOpsではモデルの品質 […]

この記事では、「AI監視」とは何か、そして以下の3つの主要領域でどのような役割を果たすのかを徹底的に解説します。

AI監視の主要領域

AIシステムの信頼性を確保し、ビジネス価値を最大化するための第一歩として、ぜひ最後までご覧ください。

まず、AI監視の基本的な考え方と、なぜ現代のビジネスにおいてこれほどまでに重要視されているのかを解説します。

AI監視とは、デプロイ(本番環境への展開)されたAIシステムが、期待されたパフォーマンスを維持し、ビジネス目標に沿って適切に機能しているかを継続的に監視・評価する一連の活動を指します。これは、従来のサーバーやネットワークの稼働状況を監視するシステム監視とは一線を画します。

AI監視の対象は多岐にわたります。具体的には、AIモデルの予測精度、入力されるデータの品質や分布の変化(データドリフト)、システムの応答速度、さらにはAIの判断が倫理的・法規的な基準を満たしているかといった側面まで含まれます。

つまり、AI監視は技術的な側面に留まらず、ビジネスやガバナンスの観点までを網羅した、より広範な概念です。この継続的監視を通じて、AIシステムの品質と信頼性を担保することが主な目的となります。

AI監視の重要性が高まっている背景には、主に2つの理由があります。

これらのリスクを管理し、AIシステムに対する「信頼性」「透明性」「説明責任」を確保することが、企業の競争力を維持し、社会からの信頼を得る上で不可欠です。AI監視は、まさにその根幹を支える重要な機能と言えるでしょう。

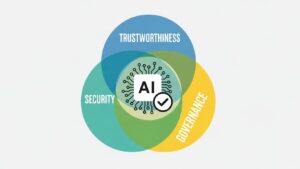

AI監視という大きな枠組みは、主に「MLOps」「AIセキュリティ」「業務監査(AIガバナンス)」という3つの密接に関連し合う領域から成り立っています。これらの領域が統合的に機能することで、AIの健全な運用が実現します。

MLOps(Machine Learning Operations)は、AIモデルの開発から運用までのライフサイクルを効率化・自動化する仕組みです。この文脈において、AI監視はモデルの品質とパフォーマンスを維持するための心臓部と言えます。

MLOpsは、機械学習(ML)と開発(Dev)、運用(Ops)を組み合わせた造語です。AIモデルを一度デプロイして終わりではなく、継続的なデータ収集、再学習、評価、再デプロイというサイクルを円滑に回すことを目指します。

このプロセスはCI/CD(継続的インテグレーション/継続的デリバリー)のパイプラインとして自動化されることが多く、AI監視は、このパイプラインが正常に機能し、生み出されるモデルの品質が担保されているかを見守る重要な役割を果たします。

MLOpsにおける監視の最も基本的な要素が、AIモデルのパフォーマンス監視です。本番環境で稼働しているモデルの予測精度(Accuracy)、再現率(Recall)、適合率(Precision)といった評価指標をリアルタイムで追跡します。

市場トレンドの変化などにより、入力データの傾向が学習時と乖離し、モデルの性能が徐々に劣化する「コンセプトドリフト」が発生します。パフォーマンス監視は、この性能劣化をいち早く検知し、再学習のトリガーを発動させるために不可欠です。

「Garbage In, Garbage Out(ゴミを入れればゴミしか出てこない)」という言葉があるように、AIモデルの性能は入力データの品質に大きく依存します。そのため、モデルそのものだけでなく、入力データやデータ処理パイプラインの監視も極めて重要です。

具体的には、データの欠損値の割合、異常値の発生頻度、特徴量の分布の変化などを継続的に監視します。これにより、品質の低いデータでモデルが誤った予測を生成し続ける事態を防ぎます。

AIシステムは、新たな価値創造の源泉であると同時に、新たな攻撃対象ともなり得ます。AIセキュリティにおける監視は、AI特有の脆弱性を狙った攻撃を検知し、システムとデータを保護するために不可欠です。

従来のファイアウォールや侵入検知システム(IDS)は、既知の攻撃パターンには有効ですが、AIシステム特有の攻撃には十分な効果を発揮できません。AIへの攻撃は、システムの内部、つまりデータやモデルそのものを標的とすることが多いためです。

例えば、以下のような新たな脅威が登場しています。

これらの攻撃からシステムを守るためには、AIの挙動自体を監視する新しいアプローチが必要です。

AIセキュリティにおける監視では、以下のような脅威を検知するための対策が講じられます。

これにより、不正な入力による誤作動や、モデルの知的財産が盗み出されるリスクを低減できます。

AIシステム、特に個人データを扱う場合、セキュリティ対策はコンプライアンス遵守と直結します。日本の個人情報保護法やEUのGDPR(一般データ保護規則)は、データの適切な管理と保護を企業に義務付けています。

AI監視は、誰が、いつ、どのデータにアクセスし、どのように利用したかという「監査証跡」をログとして記録・保管します。これは規制当局への説明責任を果たす上で重要な役割を担い、企業の法的リスクを管理するためにも不可欠です。

AIの判断がビジネスの重要な意思決定に用いられるようになると、そのプロセスが公正かつ倫理的であるかを検証する必要が出てきます。これが業務監査とAIガバナンスの視点からの監視です。

AIガバナンスとは、AIを組織全体で適切に管理・統制し、そのメリットを最大化しつつリスクを最小化するための仕組みやプロセスの総称です。具体的には、AI倫理指針の策定、リスク管理体制の構築、透明性や説明責任の確保などが含まれます。

AI監視は、このAIガバナンスの枠組みが実際に機能しているかを確認し、その実効性を担保するための重要なツールとなります。

従来の業務監査は人間が行う業務プロセスが対象でしたが、AIが業務を担うようになると、監査の対象はAIによる意思決定プロセスそのものに拡大します。

例えば、融資審査AIが特定の属性を持つ申請者を不当に差別していないか、といった点を検証する必要があります。AI監視システムは、AIの判断結果とその根拠データをログとして記録し、監査証跡を提供します。これにより、監査人はAIの判断プロセスが公平性・透明性の原則を満たしているかを客観的に評価できます。近年注目される「説明可能AI(XAI)」の技術も、この監査プロセスで重要な役割を果たします。

効果的なAIガバナンスを導入するには、体系的なアプローチが求められます。その指針となるのが、NIST(米国国立標準技術研究所)が策定した「AIリスクマネジメントフレームワーク」などの国際的なフレームワークです。

このフレームワークは、AIのリスクを「特定」「測定」「管理」「統制」するというサイクルを提示しています。AI監視は、このサイクルの「測定」と「管理」のフェーズで中心的な役割を果たし、信頼性の高いAIガバナンス体制の構築を支援します。

AI監視の重要性を理解した上で、次に具体的な導入プロセスを3つのステップで解説します。

まず、何を、何のために監視するのかを明確に定義します。全てのAIシステムに最高レベルの監視を敷くのは非現実的です。ビジネスへのインパクトやリスクが大きいシステムから優先順位をつけましょう。

その上で、「モデルの性能劣化を防ぎたい(MLOps)」「不正アクセスを検知したい(セキュリティ)」「判断の公平性を担保したい(ガバナンス)」など、主目的を定義します。目的が明確であれば、効果的で無駄のない監視システムを設計できます。

目的が明確になったら、実現するためのツールを選定します。選択肢は様々です。

自社の技術力、予算、監視要件などを総合的に評価し、最適なツールを選択することが成功の鍵です。

ツールを導入するだけではAI監視は機能しません。異常を検知した際に、誰が、どのように対応するのかという運用体制(エスカレーションフロー)を事前に設計することが不可欠です。

また、監視は一度設定して終わりではありません。ビジネスの変化や新たなリスクの出現に合わせ、監視項目や閾値を継続的に見直し、最適化していく必要があります。監視で得られた知見を開発チームにフィードバックし、AIシステム自体の品質向上につなげる改善サイクルを組織文化として根付かせることが重要です。

本記事では、AI監視の全体像を、MLOps、AIセキュリティ、業務監査(AIガバナンス)という3つの主要な領域から解説しました。

AI監視は、単なる技術的なパフォーマンス追跡ではありません。AIのライフサイクル全体を通じて、システムの品質、セキュリティ、倫理的正当性を担保するための統合的な活動です。

それぞれ支える重要な役割を担っています。

信頼できるAIシステムの構築と維持は、もはや経営課題そのものです。この記事を参考に、まずは自社のAIシステムのリスクと監視の現状を把握することから始めてみてはいかがでしょうか。それが、AIを真にビジネスの力に変えるための、確かな一歩となるはずです。

A1: 従来のシステム監視がサーバーのCPU使用率やネットワークといった「インフラの健全性」を見るのに対し、AI監視はそれに加えて「AIモデルの挙動の健全性」を監視する点が根本的に異なります。具体的には、モデルの予測精度、入力データの品質変化(データドリフト)、予測結果の公平性など、AI特有の不確実性やリスクを管理対象とします。

A2: まずは、社内で最もビジネスへの影響度が大きいAIモデルを1つ選び、そのモデルの「パフォーマンス監視」から始めることをお勧めします。予測精度や処理時間といった基本的な指標を時系列で可視化することからスタートしましょう。これにより、監視のサイクルを小さく回し始め、知見を蓄積しながら徐々に対象範囲を広げていくのが現実的で効果的なアプローチです。

A3: はい、必要です。企業の規模に関わらず、AIを利用して顧客に関わる判断を行う以上、その信頼性や公平性に対する説明責任は発生します。大規模な体制は不要ですが、NISTの「AIリスクマネジメントフレームワーク」などを参考に、自社のビジネスに合わせたリスクの洗い出しと、基本的な管理ルール(責任者、問題発生時の対応など)を定めておくことが、将来のトラブルを防ぎ、顧客からの信頼を得る上で非常に重要です。

記載されている内容は2025年12月11日時点のものです。現在の情報と異なる可能性がありますので、ご了承ください。また、記事に記載されている情報は自己責任でご活用いただき、本記事の内容に関する事項については、専門家等に相談するようにしてください。

1分でわかるこの記事の要約 サイバー攻撃調査において、ログの時刻同期がずれているとタイムライン分析が崩壊し、原因究明が困...

1分でわかるこの記事の要約 サイバー攻撃の再発防止には、目の前の暫定対処だけでなく、根本原因を取り除く恒久対応への転換が...

1分でわかるこの記事の要約 SOARによるセキュリティ自動化は強力ですが、封じ込め機能には「誤隔離」という重大なリスクが...

1分でわかるこの記事の要約 サイバーキルチェーンに基づくインシデント対応プレイブックは、サイバー攻撃の被害を最小化するた...

1分でわかるこの記事の要約 SIEM検知ルールはログ欠損や形式変更、陳腐化、プラットフォーム更新により機能不全に陥ります...

履歴書の「趣味特技」欄で採用担当者の心を掴めないかと考えている方もいるのではないでしょうか。ここでは履歴書の人事の...

いまいち難しくてなかなか正しい意味を調べることのない「ご健勝」「ご多幸」という言葉。使いづらそうだと思われがちです...

「ご査収ください/ご査収願いします/ご査収くださいますよう」と、ビジネスで使用される「ご査収」という言葉ですが、何...

選考で要求される履歴書。しかし、どんな風に書いたら良いのか分からない、という方も多いのではないかと思います。そんな...

通勤経路とは何でしょうか。通勤経路の届け出を提出したことがある人は多いと思います。通勤経路の書き方が良く分からない...